- Ce que les deepfakes font aux campagnes électorales

- L’affaire Netanyahu : anatomie d’une manipulation virale

- Pourquoi le fact-checking peine à suivre

- La psychologie du doute : quand tout devient suspect

- Les réponses techniques et réglementaires en construction

- Ce que chaque citoyen peut changer dans sa façon de consommer l’information

- FAQ — Deepfake et désinformation politique

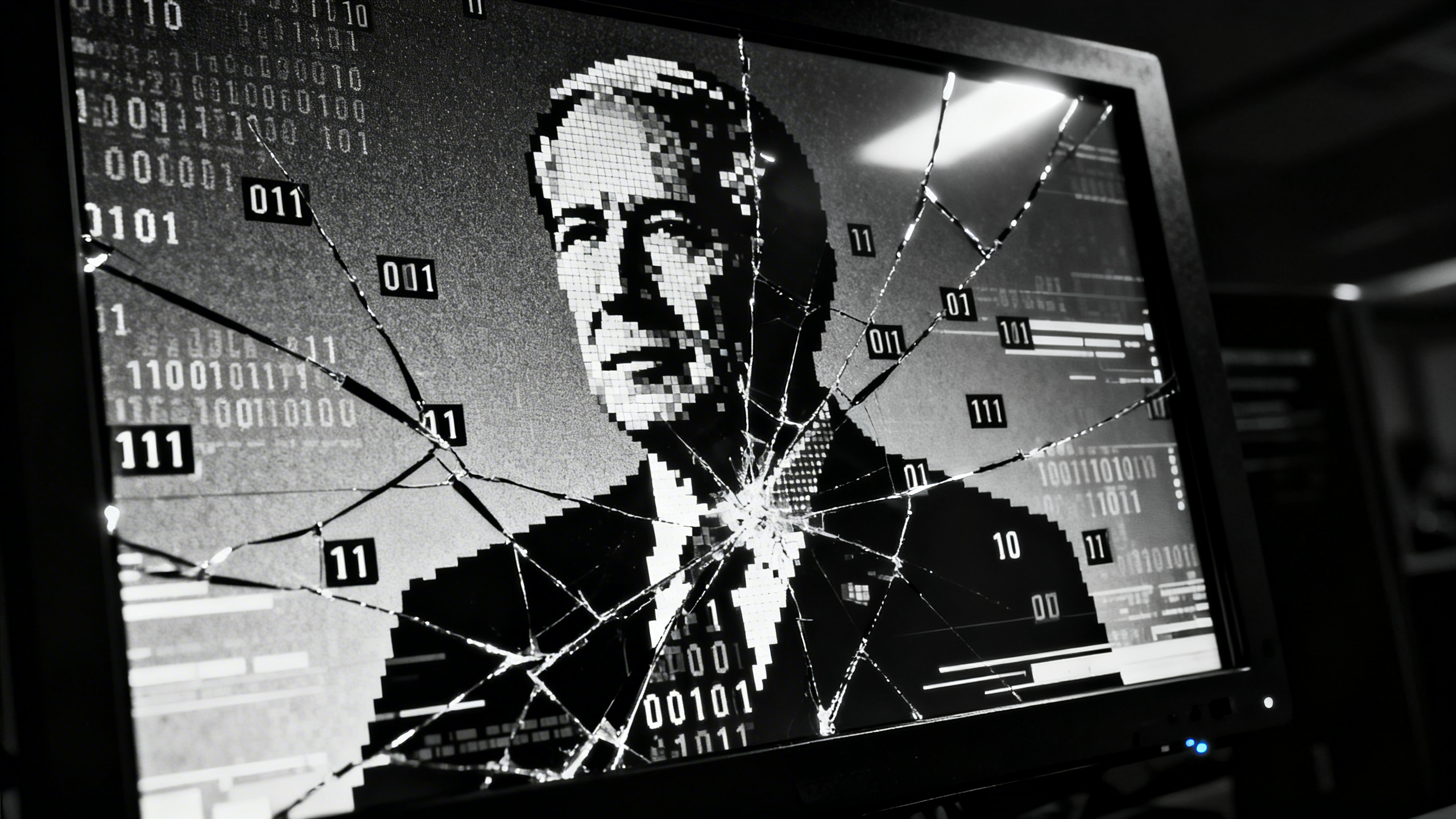

Deepfake et désinformation politique : comment l’IA manipule les élections

Vous avez peut-être vu cette vidéo circuler sur les réseaux sociaux : un chef d’État qui prononce des mots qu’il n’a jamais dits, un candidat filmé dans une situation compromettante la veille d’un scrutin décisif. Le deepfake et la désinformation politique ne sont plus une menace hypothétique — ils sont devenus un instrument de manipulation électorale à portée de clic. En 2024, plus de 60 pays ont organisé des élections majeures, et les chercheurs du MIT Media Lab ont documenté une multiplication par quatre des tentatives d’ingérence numérique via des contenus générés par intelligence artificielle. Ce que vous regardez sur votre écran n’est plus nécessairement ce qui s’est passé dans la réalité.

Ce que les deepfakes font aux campagnes électorales

Un deepfake est une vidéo, une image ou un enregistrement audio fabriqué grâce à des algorithmes d’apprentissage profond — en particulier les réseaux antagonistes génératifs (GAN). Ces modèles apprennent à imiter un visage, une voix, une gestuelle avec une précision qui dépasse désormais la capacité de détection à l’oeil nu.

Dans le contexte politique, l’effet est dévastateur pour plusieurs raisons :

- Un faux discours peut être diffusé quelques heures avant la fermeture des bureaux de vote, laissant peu de temps pour le démentir.

- La viralité des plateformes amplifie le contenu trompeur bien avant que les équipes de vérification puissent intervenir.

- Le cerveau humain traite l’information visuelle comme une preuve directe, indépendamment du contexte.

La désinformation politique par l’IA exploite précisément cette asymétrie temporelle : il faut quelques secondes pour créer le doute, et plusieurs jours pour le dissiper.

L’affaire Netanyahu : anatomie d’une manipulation virale

En 2024, une série de vidéos truquées mettant en scène Benyamin Netanyahu a circulé massivement sur les réseaux sociaux en pleine période de tension géopolitique. Ces contenus le montraient prononçant des déclarations fictives sur la conduite de la guerre à Gaza — des propos suffisamment crédibles pour être repris, commentés, puis démentis avec difficulté.

Ce cas illustre plusieurs mécanismes caractéristiques de la désinformation par deepfake :

- L’ancrage émotionnel : les fausses déclarations attribuées à Netanyahu touchaient à des enjeux de vie ou de mort, générant une réaction émotionnelle immédiate qui court-circuite l’esprit critique.

- L’effet de vérité illusoire : une fois vue plusieurs fois, une affirmation — même fausse — gagne en crédibilité perçue.

- La confusion des sources : les vidéos étaient souvent accompagnées de vraies images d’archives, rendant la frontière entre réel et fabriqué presque imperceptible.

Ce n’est pas un cas isolé. Des tentatives similaires ont ciblé Volodymyr Zelensky (une vidéo le montrant appeler à la reddition a circulé en 2022), Joe Biden lors des primaires américaines, ou encore des candidats indiens lors des élections générales de 2024. Le deepfake politique est devenu une tactique systématique, pas un accident.

Pourquoi le fact-checking peine à suivre

Le fact-checking traditionnel repose sur des délais incompatibles avec la vitesse de propagation des réseaux sociaux. Selon une étude publiée dans Science par Soroush Vosoughi et ses collègues du MIT, les fake news se propagent six fois plus vite que les informations vérifiées sur Twitter/X.

Face aux deepfakes, ce défi se redouble :

- Les outils de détection automatisée (comme ceux développés par Microsoft ou Sensity AI) affichent des taux d’erreur encore significatifs sur les contenus les plus sophistiqués.

- Les plateformes sont incitées économiquement à privilégier l’engagement sur la modération.

- La détection nécessite souvent l’accès aux métadonnées originales du fichier — rarement disponibles dans la chaîne de partage.

L’Union européenne a pris acte de ces limites avec le Digital Services Act (DSA), qui impose aux très grandes plateformes des obligations de modération renforcée sur les contenus manipulés. Mais l’application reste inégale et les sanctions tardives.

La psychologie du doute : quand tout devient suspect

L’un des effets les plus insidieux des deepfakes n’est pas de faire croire à une fausse vidéo. C’est de faire douter des vraies.

Ce phénomène a un nom : le "liar’s dividend" (dividende du menteur), théorisé par les juristes Bobby Chesney et Danielle Citron dans leur article fondateur de 2019. Un acteur politique acculé par une preuve visuelle authentique peut désormais invoquer le deepfake comme bouclier : "C’est un montage."

Cette stratégie déjà observée dans plusieurs contextes électoraux crée une épistémique toxique : les citoyens ne savent plus à quelles images se fier. La confiance dans les médias s’effrite, et avec elle la capacité collective à distinguer le vrai du faux. Une étude du Reuters Institute for the Study of Journalism (2024) montre que 55 % des personnes interrogées déclarent avoir du mal à identifier les contenus générés par IA dans leur flux d’information quotidien.

Ce n’est pas un problème d’intelligence individuelle. C’est l’architecture même des systèmes de manipulation qui est conçue pour saturer la capacité critique.

Les réponses techniques et réglementaires en construction

Des pistes existent, mais aucune n’est encore suffisante à elle seule. Du côté technique, le watermarking des contenus générés par IA — c’est-à-dire l’intégration d’un marqueur invisible dans chaque fichier produit par un modèle — fait l’objet d’efforts coordonnés. La coalition C2PA (Coalition for Content Provenance and Authenticity), qui regroupe Adobe, Intel, Microsoft et plusieurs médias, développe un standard de certification de l’origine des images.

Du côté réglementaire, les avancées sont hétérogènes :

- Aux États-Unis, plusieurs États ont adopté des lois spécifiques interdisant les deepfakes électoraux dans les semaines précédant un scrutin.

- En Europe, le AI Act adopté en 2024 classe les systèmes de manipulation comportementale et les deepfakes non étiquetés comme risques élevés ou inacceptables.

- En Chine, la réglementation impose depuis 2023 un étiquetage obligatoire de tous les contenus synthétiques.

Aucune de ces approches ne résout seule le problème. La rapidité d’évolution des modèles génératifs dépasse structurellement la cadence législative.

Ce que chaque citoyen peut changer dans sa façon de consommer l’information

Face à cette réalité, la littératie médiatique numérique devient une compétence civique fondamentale. Non pas pour devenir expert en forensique vidéo, mais pour adopter quelques réflexes de base.

Vérifier la source primaire avant de partager, croiser avec plusieurs médias indépendants, se méfier des contenus qui provoquent une réaction émotionnelle immédiate et intense — ce sont des pratiques que les organisations comme First Draft ou l’AFP Factuel recommandent et enseignent activement dans les programmes de formation au journalisme.

Le deepfake politique prospère dans les espaces où la vérification est absente et l’émotion abondante. Réduire cet espace, même individuellement, change l’équation de la manipulation.

Points clés à retenir :

- Les deepfakes électoraux exploitent l’asymétrie temporelle : le faux contenu se propage avant que la vérification puisse intervenir.

- L’affaire Netanyahu illustre comment un contenu truqué peut atteindre des millions de personnes avant tout démenti officiel.

- Le "liar’s dividend" permet aux acteurs de mauvaise foi de discréditer de vraies preuves en invoquant la possibilité du deepfake.

- Les outils techniques (watermarking, détection automatisée) et réglementaires (DSA, AI Act) progressent, mais restent en retard sur les capacités des modèles génératifs.

- La littératie médiatique numérique est la première ligne de défense accessible à chaque citoyen.

FAQ — Deepfake et désinformation politique

Qu’est-ce qu’un deepfake politique exactement ?

Un deepfake politique est un contenu vidéo, audio ou photographique falsifié à l’aide d’intelligence artificielle pour faire dire ou faire à une personnalité publique quelque chose qu’elle n’a pas dit ou fait. Dans un contexte électoral, ces contenus sont utilisés pour influencer l’opinion publique, nuire à la réputation d’un candidat ou semer la confusion dans les jours précédant un vote.

Comment reconnaître une vidéo deepfake ?

Plusieurs indices peuvent alerter : des mouvements de lèvres légèrement désynchronisés avec l’audio, des contours du visage flous ou instables, des clignements d’yeux anormaux, ou une qualité de peau trop uniforme. Des outils comme Deepware Scanner ou InVID/WeVerify permettent une analyse automatisée, mais les deepfakes les plus récents sont de plus en plus difficiles à détecter à l’oeil nu.

Les deepfakes ont-ils déjà influencé le résultat d’une élection ?

Il n’existe pas de preuve directe qu’un deepfake ait à lui seul renversé un résultat électoral. En revanche, des études comme celle de l’Oxford Internet Institute documentent leur impact sur la perception des candidats et sur les niveaux de confiance envers les institutions. L’influence est diffuse et cumulative, pas forcément décisive sur un scrutin isolé.

Que fait l’Union européenne contre les deepfakes électoraux ?

Le Digital Services Act impose aux plateformes très grandes audiences (plus de 45 millions d’utilisateurs en Europe) des obligations de modération renforcée, notamment sur les contenus manipulés en période électorale. L’AI Act, adopté en 2024, impose par ailleurs un étiquetage obligatoire des contenus générés par IA et interdit certaines applications de manipulation comportementale.

Pourquoi est-il si difficile de supprimer un deepfake une fois publié ?

La suppression d’un contenu sur une plateforme ne l’empêche pas d’avoir été copié, repartagé et archivé sur d’autres espaces. Les réseaux de messagerie chiffrés (Telegram, WhatsApp) rendent la modération presque impossible. De plus, l’empreinte mémorielle d’une image vue — même brièvement — persiste chez les spectateurs bien après la suppression du contenu original.

Laisser un commentaire